La vie était bien plus simple lorsque nos fils sociaux ne contenaient que des photos de chats et des mèmes. Pourtant, au cours de l’année écoulée, vos fils d’actualité ont peut-être été très différents. Vous êtes peut-être tombé sur des photos qui semblent trop exagérées pour être vraies. Vous auriez même pu croire qu’ils étaient réels si on ne vous avait pas dit le contraire.

La diffusion stable, Dall-E et Midjourney étant de plus en plus performants en matière de génération d’images, il est de plus en plus difficile de déterminer si les images que vous voyez en ligne sont vraies ou fausses.

Dans cet article, nous vous présentons huit images générées par l’intelligence artificielle qui sont devenues virales et nous explorons leurs implications.

Le Pape en Drip Balenciaga

Source : Twitter

Nous doutons que beaucoup d’entre eux aient inscrit « image du pape portant un blouson » sur leur carte de bingo cette année. Cette photo du Pape portant une veste Balenciaga est sans doute la photo la plus influente depuis le début de l’année.

Il a été visionné des millions de fois et aimé des centaines de milliers de fois.

Le créateur a expliqué qu’il expérimentait avec Midjourney lorsqu’il a décidé de faire de l’art surréaliste. « J’ai juste pensé que c’était drôle de voir le Pape dans une drôle de veste.

Ce qui la rend si impressionnante, c’est le caractère convaincant de l’image. L’image de l’IA ne présente pas de signes évidents indiquant qu’elle a été créée par un générateur de photos d’IA, tels que des mains ou un visage bizarres.

L’image de l’IA présentait une esthétique hyperréaliste qui en a trompé plus d’un. Malgré les signes révélateurs d’une création par l’IA, tels que les détails maculés, l’image du pape en costume d’apparat s’est répandue comme une traînée de poudre sur les plates-formes de médias sociaux. Chrissy Teigen s’est laissée berner et a tweeté: « J’ai cru que la veste polaire du pape était réelle et je n’y ai pas réfléchi une seconde. Je ne survivrai jamais à l’avenir de la technologie ».

Ce fut l’un des premiers cas de désinformation généralisée, mettant en évidence le pouvoir et les dangers potentiels de cette technologie.

L’arrestation de Trump

Source : Twitter

Au début de l’année, l’ancien président Donald Trump attendait son verdict pour savoir s’il serait inculpé ou non. Alors que le monde entier attendait le résultat, quelqu’un a créé des images de ce à quoi ressemblerait l’arrestation de Trump.

Eliot Higgins, fondateur de la plateforme journalistique Bellingcat, a fait grand bruit en tweetant le 21 mars : « Faire des photos de Trump se faisant arrêter en attendant l’arrestation de Trump ».

Il a partagé une série d’images de Trump traîné par plusieurs policiers. Le contenu généré par l’IA a été réalisé avec Midjourney et a été visionné 6,7 millions de fois.

L’intention de Higgins était simplement de montrer la puissance des outils de création d’images par l’IA. Nous pensons qu’il a prouvé son point de vue.

Paris couvert d’ordures

Source : Facebook

À première vue, une série d’images frappantes semble dépeindre Paris, la célèbre Ville Lumière, comme une métropole submergée par des montagnes de déchets. Le contexte était crédible : les éboueurs s’étaient en effet mis en grève plus tôt dans l’année, ce qui avait donné lieu à des scènes dramatiques d’ordures dans les rues et même devant les maisons des politiciens. Toutefois, un examen plus approfondi a révélé un revirement dans le récit.

Publiées en août, ces images, qui montrent la Tour Eiffel et le Musée du Louvre encerclés par des déchets, n’étaient pas des clichés des conséquences d’une grève : elles avaient été générées par l’IA. Les images proviennent d’une vidéo TikTok, qui a été visionnée plus de 450 000 fois.

Le site de vérification des faits AFP a retrouvé l’origine des images sur la page Facebook d’un artiste connu sous le nom de Nik Art, qui a confirmé que les images avaient été réalisées avec Midjourney.

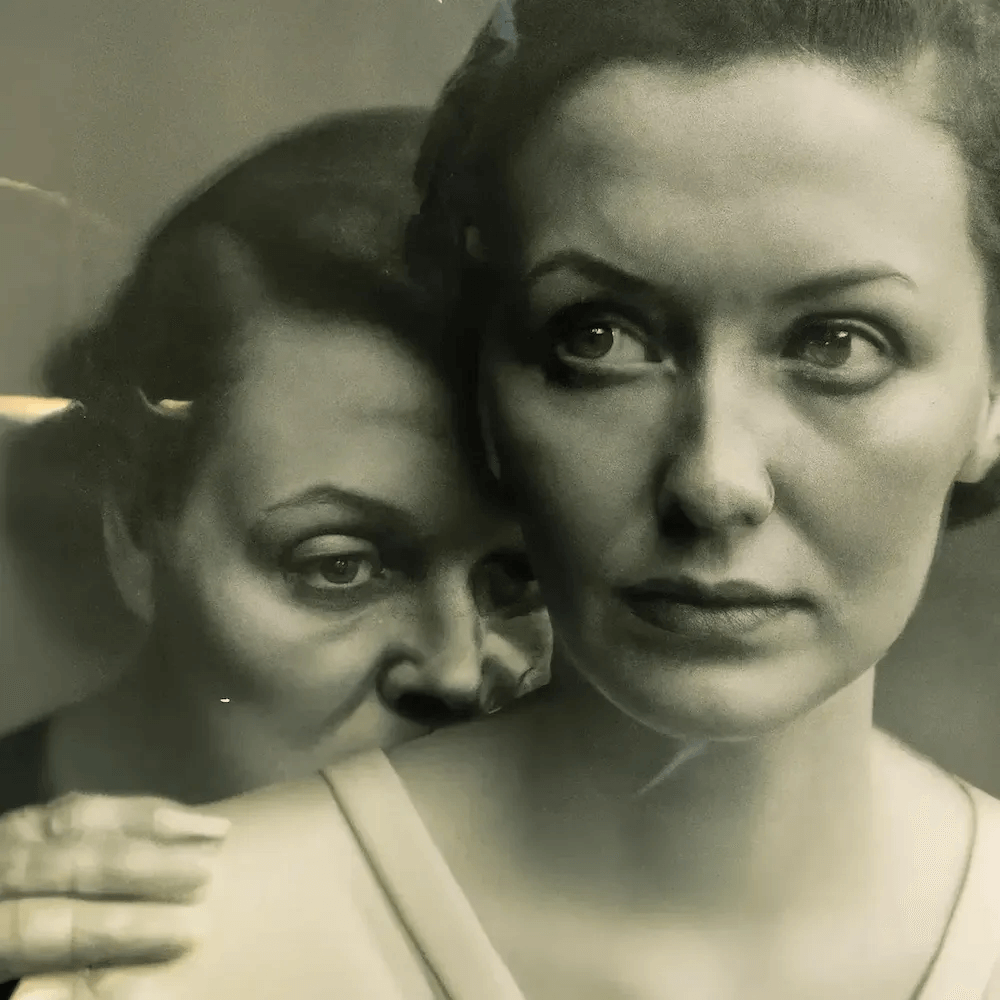

L’IA remporte le prestigieux prix Sony

Source : BBC

Les juges ont été surpris par la proposition de Boris Eldagsen, intitulée « Pseudomnesia : The Electrician » (Pseudomnésie : l’électricien). L’image était si bonne qu’elle a remporté le Sony World Photography Award cette année.

Sauf que ce n’est pas le cas, puisque Eldagsen a refusé le prix après avoir révélé que l’œuvre gagnante avait été générée par l’IA. Lors d’entretiens ultérieurs, il a expliqué qu’il souhaitait engager un dialogue sur le rôle de l’IA dans l’avenir des arts visuels.

L’image d’Eldagsen, un portrait obsédant en noir et blanc, est devenue virale, démontrant la capacité de l’IA à imiter la réalité de manière convaincante. Cet incident a amplifié les discussions sur la place de l’IA dans l’art, de nombreuses personnes appelant à une différenciation claire entre les œuvres générées par l’IA et les œuvres créées par l’homme dans les concours.

Le Pentagone en (fausses) flammes

Source : Bloomberg Bloomberg

Une autre entrée choquante dans cette liste a peut-être eu le plus grand impact en termes de mise en lumière de la création d’images par l’IA. En mai dernier, l’image d’une explosion près du Pentagone a fait le tour de Twitter.

Si le créateur officiel ne s’est jamais dévoilé (pour des raisons évidentes), les images se sont rapidement révélées fausses. Cela dit, l’image a semé la panique et la confusion, provoquant même des remous sur les marchés boursiers.

Il s’agit d’un rappel brutal de l’utilisation potentiellement abusive de la technologie de l’IA pour créer des faux convaincants qui, combinés à la nature virale de plateformes telles que Twitter, peuvent se propager plus rapidement qu’ils ne peuvent être vérifiés.

Un compte Instagram entièrement composé de fausses personnes

Source : Ars Technica Ars Technica

Imaginez que la culpabilité d’avoir trompé tous ceux qui vous suivent pèse si lourdement sur vous que vous vous sentez obligé de tout avouer. En janvier 23, Jos Avery a déclaré à Ars Technica que les images qu’il publiait sur Instagram étaient « générées par l’IA et finies par l’homme ».

Normalement, cela ne poserait pas de problème, mais les adeptes de plus en plus nombreux d’Avery étaient stupéfaits par ses compétences techniques et sa maîtrise de son métier. Le problème, c’est qu’il ne pouvait pas se résoudre à avouer que l’IA avait joué un rôle important dans le processus artistique.

S’il ne révélait pas son processus en coulisses, connaîtrions-nous jamais la vérité ?

Musc et Barra main dans la main

Source : Twitter

Le fait de voir Elon Musk tenir la main de sa concurrente chez General Motors, Mary Barra, a certainement fait froncer les sourcils lorsque les images ont été publiées pour la première fois.

Cette image virale, créée par Brian Lovett de Midjourney, montrait les deux PDG rivaux marchant main dans la main comme s’ils sortaient ensemble. Il était évident qu’il s’agissait d’images d’IA dues à l’absurdité même de la situation.

Musk a pris cela avec bonne humeur et a répondu : « Je ne porterais jamais cette tenue ».

Un modèle d’IA avec plus de followers que vous et moi

Source : Instagram

Il est aussi courant de voir un compte d’influenceur que de prendre des selfies. L’intro de la bio Instagram de Milla Sofia, « fille virtuelle de 24 ans vivant à Helsinki », n’a donc rien d’extraordinaire.

« Je suis une création de l’IA », c’est là que ça devient intéressant.

Sofia est un modèle généré par l’IA. Toutes les photos qu’elle prend sur ses plateformes de médias sociaux sont également réalisées avec l’IA, mais dans le format approprié que l’on attend des influenceurs.

Elle est devenue virale pour la première fois lorsqu’elle a partagé un clip TikTok vêtue de vêtements d’été avec un champ de fleurs en toile de fond. D’autres utilisateurs de TikTok l’ont complimentée, bien qu’elle ait annoncé publiquement qu’elle était un modèle d’IA.

Sofia est un exemple de la façon dont les images et les personnes générées par l’IA sont de plus en plus acceptées dans la société actuelle. En fait, certains modèles d’IA ont même réussi à obtenir des parrainages de la part de marques.

Comment distinguer les images générées par l’IA des images réelles ?

Il était auparavant assez simple de faire la distinction entre les images générées par l’IA et les images réelles. Il suffit de rechercher les signes révélateurs que sont les détails flous ou le rendu inhabituel des mains et des pieds.

Mais l’IA devient de plus en plus intelligente et ces indices deviennent moins évidents. Pour vous aider à repérer les images générées par l’IA, vous devez creuser un peu plus loin. Vous pouvez le faire en appliquant la méthode SIFT :

- Stop : prenez le temps de vous arrêter et d’évaluer l’image de manière critique avant de la considérer comme réelle.

- Étudier : Approfondissez l’image en examinant ses détails, en recherchant des incohérences ou des éléments inhabituels.

- Trouver une meilleure couverture : Recherchez des sources supplémentaires ou des informations connexes qui peuvent fournir plus de détails sur l’origine et l’authenticité de l’image.

- Retrouver le contexte d’origine : Remonter à la source de l’image pour vérifier sa légitimité et empêcher la diffusion d’informations erronées.

Cela permet de distinguer le vrai du faux et de se tenir à l’écart des fausses nouvelles.

Comment les grandes entreprises technologiques luttent contre la désinformation

Bien que vous puissiez rester vigilant, il est de plus en plus difficile de savoir si une image a été créée à l’aide d’outils d’IA générative. Vous pouvez créer des images dans des applications facilement accessibles comme Dall-E via un abonnement ChatGPT Plus ou Midjourney.

La fausse image du Pentagone a semé la panique pendant quelques instants, l’internet se demandant si elle était bien réelle. Heureusement, elle a été rapidement démentie. Mais cela soulève la question de savoir si les grands acteurs technologiques peuvent faire quelque chose pour faciliter la distinction entre les vraies et les fausses images.

Il a été suggéré de mettre en place des empreintes invisibles ou des filigranes. Google, Adobe et Microsoft approuvent les labels de contenu d’IA. Google prévoit d’ajouter des informations sur les images générées par l’IA, tandis que les références de contenu d’Adobe permettent de suivre les modifications apportées par l’IA, à la manière d’un étiquetage nutritionnel numérique.

Toutefois, ces outils ne sont pas infaillibles et des manipulations sont possibles. De tels labels pourraient être essentiels pour discerner la vérité dans notre monde numériquement complexe, malgré les défis à relever.

Réflexions finales

Comme nous l’avons vu, la capacité de l’IA à créer des images a atteint de nouveaux sommets, en tissant astucieusement des pixels pour créer des images qui peuvent tromper même les yeux les plus aiguisés.

Ces huit sensations virales ne sont qu’un aperçu d’un avenir où la frontière entre le trait d’un artiste et le code d’un algorithme devient indiscernable. Cela nous rappelle que, si nous pouvons apprécier les merveilles d’une telle technologie, nous devons également faire preuve de prudence et veiller à garder un pied dans la réalité lorsque nous pénétrons dans le monde de plus en plus complexe que l’IA est en train de peindre pour nous.

Il existe bien sûr d’autres façons d’utiliser l’IA pour la génération d’images. Si vous avez besoin d’un outil d’IA pour le contenu long format et les visuels de données, pourquoi ne pas essayer Piktochart AI?

Vous pouvez créer une grande variété de visuels à partir d’un seul message. Notre outil génère une série de visuels sur la base de votre demande et les associe aux modèles les plus appropriés de notre vaste galerie. Vous n’avez qu’à choisir le meilleur du lot, puis à le personnaliser dans notre éditeur jusqu’à ce qu’il corresponde à vos besoins.