La vita era molto più semplice quando i nostri feed sociali contenevano solo foto di gatti e meme. Tuttavia, nel corso dell’ultimo anno, i vostri feed potrebbero aver avuto un aspetto molto diverso. Potreste esservi imbattuti in alcune foto che sembrano troppo strane per essere vere. Potreste persino credere che siano reali, se non vi fosse stato detto nulla di diverso.

Con Stable Diffusion, Dall-E e Midjourney che migliorano la generazione di immagini, è sempre più difficile capire se le immagini che si vedono online sono vere o false.

In questo articolo condivideremo otto immagini generate da ai che sono diventate virali e ne esploreremo le implicazioni.

Il Papa in Balenciaga Drip

Fonte: Twitter

Dubitiamo che quest’anno molti avessero “l’immagine del Papa che indossa una giacca a vento” sulle loro cartelle del bingo. Questa foto di AI del Papa che indossa un giubbotto di Balenciaga è forse la foto più AI di quest’anno.

È stato visto milioni di volte e apprezzato centinaia di migliaia di volte.

Il creatore ha raccontato che stava sperimentando con Midjourney quando ha deciso di realizzare un’arte surreale. “Ho solo pensato che fosse divertente vedere il Papa con una giacca buffa”.

Ciò che lo rende così impressionante è il grado di persuasione dell’immagine. L’immagine dell’IA non presenta alcun segno evidente che indichi che è stata realizzata da un generatore di foto dell’IA, come ad esempio mani o volto dall’aspetto strano.

L’immagine AI mostrava un’estetica iperreale che ha ingannato molti. Nonostante i segni rivelatori della creazione da parte dell’AI, come i dettagli sbavati, l’immagine del Papa in stile spavaldo si è diffusa a macchia d’olio sulle piattaforme dei social media. Ha ingannato Chrissy Teigen, che ha twittato: “Pensavo che il giubbotto del Papa fosse vero e non ci ho pensato due volte”. non ho alcuna possiblità di sopravvivere al futuro della tecnologia”.

È stato uno dei primi casi di disinformazione diffusa, che ha messo in luce la potenza e i potenziali pericoli di questa tecnologia.

Trump arrestato

Fonte: Twitter

All’inizio dell’anno, l’ex presidente Donald Trump era in attesa del verdetto sulla sua incriminazione o meno. Mentre il mondo attendeva il risultato, qualcuno ha creato immagini di come sarebbe stato se Trump fosse stato arrestato.

Eliot Higgins, fondatore della piattaforma giornalistica Bellingcat, ha fatto scalpore quando il 21 marzo ha twittato: “Fare foto di Trump che viene arrestato in attesa dell’arresto di Trump”.

Ha condiviso una serie di immagini di Trump che viene trascinato via da diversi poliziotti. I contenuti generati dall’intelligenza artificiale sono stati realizzati con Midjourney e sono stati visualizzati 6,7 milioni di volte.

L’intenzione di Higgins era solo quella di mostrare quanto fossero potenti gli strumenti di creazione di immagini AI. Pensiamo che abbia dimostrato il suo punto di vista.

Parigi ricoperta di rifiuti

Fonte: Facebook

A prima vista, una serie di immagini suggestive sembrava ritrarre Parigi, la rinomata Città della Luce, come una metropoli sommersa da montagne di rifiuti. Il contesto era credibile: i lavoratori della nettezza urbana avevano infatti scioperato all’inizio dell’anno, dando luogo a scene drammatiche di rifiuti per le strade e persino davanti alle case dei politici. Tuttavia, uno sguardo più approfondito ha rivelato una svolta nella narrazione.

Pubblicate in agosto, queste immagini, che mostravano la Torre Eiffel e il Museo del Louvre circondati dai rifiuti, non erano istantanee delle conseguenze di un attacco: erano generate dall’intelligenza artificiale. Le immagini provengono da un video di TikTok, che è stato visualizzato oltre 450.000 volte.

Il sito di fact-checking AFP ha rintracciato le origini delle immagini sulla pagina Facebook di un artista noto come Nik Art, che ha confermato che le immagini sono state realizzate con Midjourney.

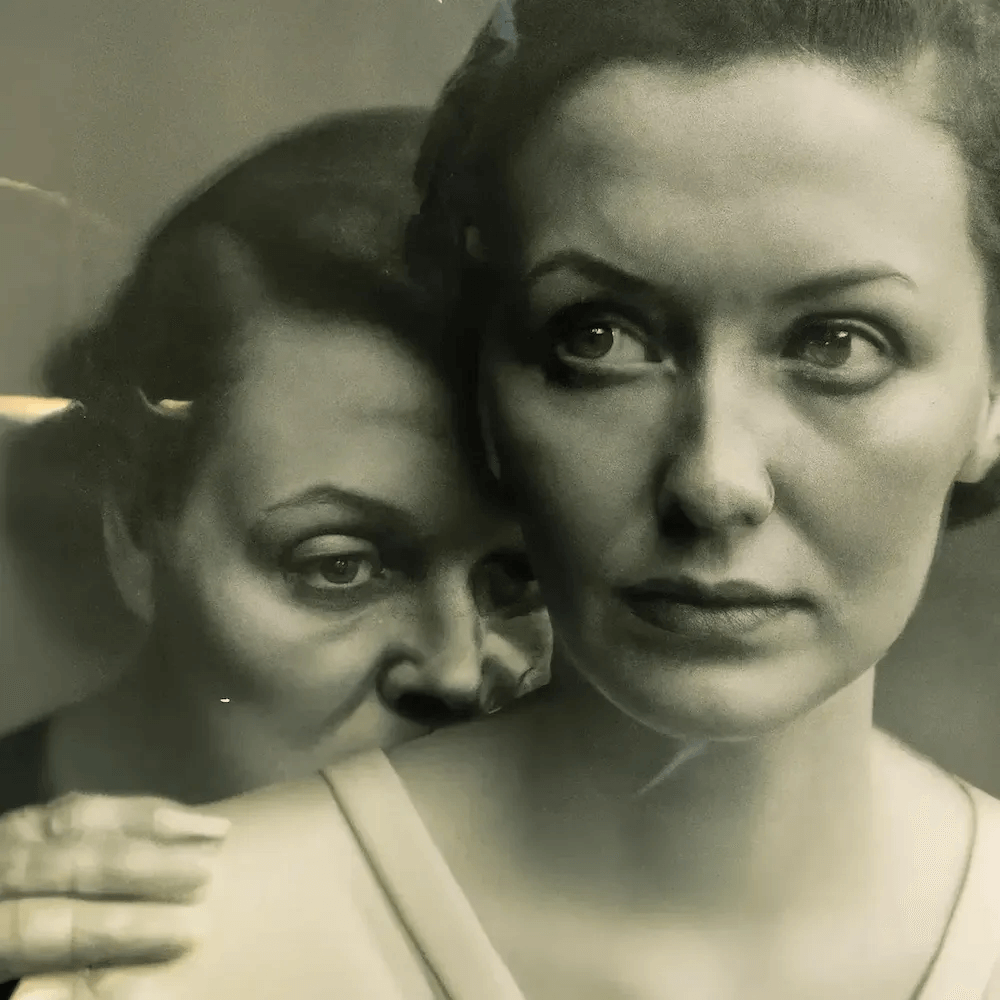

AI vince il prestigioso premio Sony

Fonte: BBC

I giudici sono stati sorpresi dal lavoro di Boris Eldagsen, intitolato “Pseudomnesia: The Electrician”. L’immagine era così buona che ha vinto il Sony World Photography Award di quest’anno.

Ma non è stato così, quando Eldagsen ha rifiutato il premio dopo aver rivelato che il pezzo vincitore era stato generato dall’intelligenza artificiale. In interviste successive, ha dichiarato di voler avviare un dialogo sul ruolo dell’IA nel futuro delle arti visive.

L’immagine di Eldagsen, un’inquietante rappresentazione in bianco e nero, ha raggiunto uno status virale, dimostrando la capacità dell’intelligenza artificiale di imitare la realtà in modo convincente. Questo incidente ha amplificato le discussioni sul posto dell’IA nell’arte, con molti che chiedono una chiara differenziazione tra le opere generate dall’IA e quelle realizzate dall’uomo nei concorsi.

Pentagono in (finte) fiamme

Fonte: Bloomberg: Bloomberg

Un’altra voce scioccante di questo elenco ha forse avuto l’impatto maggiore in termini di creazione di immagini AI al pubblico. Nel maggio di quest’anno, un’immagine di un’esplosione vicino al Pentagono ha fatto il giro di Twitter.

Sebbene il creatore ufficiale non si sia mai rivelato (per ovvie ragioni), le immagini si sono subito rivelate false. Detto questo, l’immagine ha scatenato panico e confusione, provocando persino delle increspature nel mercato azionario.

Si tratta di un chiaro promemoria del potenziale uso improprio della tecnologia AI per la creazione di falsi convincenti che, combinati con la natura virale di piattaforme come Twitter, possono diffondersi più velocemente di quanto possano essere verificati.

Intero account Instagram di persone finte

Fonte: Ars Technica

Immaginate il senso di colpa per aver ingannato tutti i vostri seguaci che vi pesa così tanto da farvi sentire in dovere di confessare. Il 23 gennaio Jos Avery ha dichiarato ad Ars Technica che le immagini da lui pubblicate su Instagram erano “generate dall’intelligenza artificiale e rifinite dall’uomo”.

Di solito questo non sarebbe un problema, ma la crescente base di seguaci di Avery è rimasta stupita dalla sua abilità tecnica e dalla padronanza del suo mestiere. Il problema era che non riusciva a confessare che l’IA aveva svolto un lavoro pesante nel processo artistico.

Se non rivelasse il suo processo dietro le quinte, sapremmo mai la verità?

Musk e Barra mano nella mano

Fonte: Twitter

Vedere Elon Musk che si tiene per mano con la sua concorrente della General Motors, Mary Barra, ha certamente fatto sollevare le sopracciglia quando le immagini sono state pubblicate per la prima volta.

L’immagine virale, realizzata da Brian Lovett con Midjourney, mostra i due CEO rivali che camminano mano nella mano come se si stessero frequentando. Era evidente che si trattava di immagini dell’IA per la pura assurdità della situazione.

Musk l’ha presa con filosofia, rispondendo: “Non indosserei mai quel vestito”.

Una modella AI con più follower di me e te

Fonte: Instagram

Vedere un account di influencer è comune quanto le persone che si scattano dei selfie. Quindi l’introduzione di Milla Sofia alla sua biografia di Instagram, “ragazza virtuale di 24 anni che vive a Helsinki”, non è nulla di eccezionale.

“Sono una creazione dell’IA” è il punto in cui il discorso si fa interessante.

Sofia è un modello generato dall’intelligenza artificiale. Anche tutte le sue foto sulle piattaforme dei social media sono realizzate con l’AI, anche se nel formato appropriato che ci si aspetta dagli influencer.

La prima volta è diventata virale quando ha condiviso una clip su TikTok vestita con abiti estivi sullo sfondo di un campo di fiori. Altri utenti di TikTok si sono complimentati con lei, nonostante l’annuncio pubblico che si tratta di una modella AI.

Sofia è un esempio di come le immagini e le persone generate dall’intelligenza artificiale stiano diventando sempre più accettate nella società di oggi. In effetti, alcuni modelli di AI hanno persino ottenuto sponsorizzazioni da parte dei marchi.

Come distinguere tra immagini generate dall’intelligenza artificiale e immagini reali

Un tempo capire la distinzione tra le immagini generate dall’intelligenza artificiale e quelle reali era piuttosto semplice. Basta cercare i segni rivelatori di dettagli sfocati o di una resa insolita di mani e piedi.

Ma l’intelligenza artificiale sta diventando più intelligente e questi indizi sono sempre meno evidenti. Per individuare le immagini generate da ai, è necessario scavare un po’ più a fondo. È possibile farlo applicando il metodo SIFT:

- Fermarsi: fermarsi un attimo e valutare criticamente l’immagine prima di accettarla come reale.

- Indagare: Approfondite l’immagine esaminandone i dettagli, alla ricerca di eventuali incongruenze o elementi insoliti.

- Trovare una copertura migliore: Cercare fonti aggiuntive o informazioni correlate che possano fornire un contesto più ampio sull’origine e l’autenticità dell’immagine.

- Rintracciare il contesto originale: Risalire alla fonte originale dell’immagine per verificarne la legittimità e prevenire la diffusione di informazioni errate.

Questo aiuta a distinguere il vero dal falso e a evitare le fake news.

Come le principali aziende tecnologiche stanno fermando la disinformazione

Anche se è possibile rimanere vigili, sta diventando sempre più difficile capire se un’immagine è stata creata da strumenti di IA generativa. È possibile creare immagini in applicazioni facilmente accessibili come Dall-E tramite un abbonamento ChatGPT Plus o Midjourney.

L’immagine falsa del Pentagono ha scatenato il panico per un breve periodo, mentre su Internet ci si chiedeva se fosse reale. Per fortuna, è stata rapidamente sfatata. Ma ci si chiede se i grandi player tecnologici possano fare qualcosa per facilitare la distinzione tra immagini vere e false.

Un suggerimento è stato quello di implementare impronte o filigrane invisibili. E Google, Adobe e Microsoft approvano l’approvazione di etichette di contenuti AI. Google prevede di aggiungere informazioni alle immagini generate dall’intelligenza artificiale, mentre le credenziali di contenuto di Adobe tracciano le modifiche dell’intelligenza artificiale, agendo come un’etichetta nutrizionale digitale.

Tuttavia, questi strumenti non sono infallibili e la manipolazione è possibile. Tali etichette potrebbero essere la chiave per discernere la verità nel nostro mondo digitalmente complesso, nonostante le sfide.

Considerazioni finali

Come abbiamo visto, la capacità dell’intelligenza artificiale di creare immagini ha raggiunto nuove vette, intrecciando abilmente i pixel in immagini che possono ingannare anche gli occhi più acuti.

Queste otto sensazioni virali sono solo un assaggio di un futuro in cui il confine tra il tratto di un artista e il codice di un algoritmo diventa indistinguibile. Ci ricorda che, se da un lato possiamo apprezzare le meraviglie di questa tecnologia, dall’altro dobbiamo fare attenzione a mantenere un piede nella realtà quando entriamo nel mondo sempre più complesso che l’intelligenza artificiale sta dipingendo per noi.

Esistono naturalmente altri modi per utilizzare l’intelligenza artificiale per la generazione di immagini. Se avete bisogno di uno strumento di intelligenza artificiale per contenuti di lunga durata e visualizzazioni di dati, perché non provare Piktochart AI?

È possibile creare un’ampia varietà di immagini a partire da un’unica richiesta. Il nostro strumento genererà una serie di immagini in base alle vostre richieste e le abbinerà ai modelli più appropriati della nostra vasta galleria. Non vi resta che scegliere il migliore del gruppo e personalizzarlo nel nostro editor fino a quando non si adatta alle vostre esigenze.